Crawling en indexatie strategie: zo stuur je zoekmachines bewust naar je belangrijkste pagina’s

Wie zoekt op crawling en indexatie strategie, zoekt meestal meer dan een technische uitleg. De echte vraag is vaak strategischer: hoe zorg je ervoor dat zoekmachines de juiste pagina’s op je website ontdekken, verwerken en opnemen in Google, zonder tijd te verspillen aan irrelevante URL’s?

Dat is een belangrijke vraag. Veel websites publiceren content, bouwen landingspagina’s en verbeteren hun interne links, maar laten crawling en indexatie grotendeels aan toeval over. Daardoor worden belangrijke pagina’s soms te laat ontdekt, raken onbelangrijke URL-varianten in de index of ontstaan er tegenstrijdige signalen tussen canonicals, sitemaps en interne structuur.

Voor websites die werken met een pillar-and-cluster model is dat extra relevant. Je wilt dat zoekmachines niet alleen losse URL’s zien, maar ook begrijpen welke pagina’s het hoofdonderwerp dragen en welke content ondersteunend is. In dit artikel lees je wat een crawling en indexatie strategie is, waarom die belangrijk is en hoe je die in de praktijk goed opbouwt.

Wat is crawling en indexatie strategie?

Een crawling en indexatie strategie is de planmatige manier waarop je bepaalt welke pagina’s zoekmachines moeten ontdekken, hoe makkelijk ze die kunnen bereiken en welke URL’s uiteindelijk in de index horen te komen.

Crawling gaat over ontdekking en verwerking. Zoekmachines vinden URL’s via interne links, XML-sitemaps, externe links en eerder bekende pagina’s. Indexatie gaat over selectie. Google beslist welke pagina’s worden opgenomen in de zoekindex en dus kunnen verschijnen in de zoekresultaten.

Een strategie verbindt die twee processen aan je SEO-doelen. Je laat dan niet simpelweg alle URL’s bestaan en hopen dat Google de juiste keuzes maakt, maar stuurt actief op vragen als:

- welke pagina’s zijn echt belangrijk

- welke URL-typen hebben SEO-waarde

- welke pagina’s horen niet in de index

- hoe ondersteun je prioriteit via interne links en sitemaps

- hoe voorkom je technische ruis en doublures

Daarmee wordt crawling en indexatie geen losse technische controle, maar onderdeel van je bredere SEO-architectuur.

Waarom crawling en indexatie belangrijk zijn

Zonder crawling ontdekt Google je pagina’s niet goed. Zonder indexatie kunnen die pagina’s niet ranken. Dat maakt deze processen fundamenteel voor SEO.

De strategische waarde zit echter vooral in focus. Zoekmachines hebben niet automatisch inzicht in jouw commerciële of inhoudelijke prioriteiten. Ze leiden die af uit de structuur van je website en uit technische signalen. Als die signalen zwak of tegenstrijdig zijn, krijgen hoofdpagina’s minder duidelijke ondersteuning en kunnen irrelevante URL’s onnodig veel aandacht opeisen.

Voor grotere websites is dat nog belangrijker. Hoe meer URL’s, filters, parameters, tags en technische varianten een site bevat, hoe groter de kans dat crawling inefficiënt wordt en de index vervuilt. Een goede crawling en indexatie strategie voorkomt dat.

Hoe crawling en indexatie strategisch werken

Een goede strategie begint met het besef dat niet elke URL hetzelfde doel heeft. Sommige pagina’s zijn bedoeld om organisch verkeer aan te trekken. Andere bestaan puur voor navigatie, filtering, gebruikersfunctionaliteit of technische verwerking.

Daarom werkt een crawling en indexatie strategie het best wanneer je drie dingen helder maakt:

Welke pagina’s prioriteit hebben

Je moet eerst weten welke URL’s echt belangrijk zijn. Dat zijn meestal categoriepagina’s, dienstenpagina’s, pillar pages en andere landingspagina’s die zichtbaar moeten zijn in Google.

Welke signalen die prioriteit ondersteunen

Belangrijke pagina’s moeten intern goed bereikbaar zijn, logisch in de sitehiërarchie staan, een duidelijke canonical hebben en opgenomen worden in een schone XML-sitemap als dat passend is.

Welke URL’s je juist wilt afremmen of uitsluiten

Niet elke URL hoeft geïndexeerd te worden. Filtercombinaties, interne zoekresultaten, parameterpagina’s en andere technische varianten kunnen nuttig zijn voor gebruikers, maar hoeven niet per se in Google te verschijnen. Strategie betekent dus ook keuzes maken.

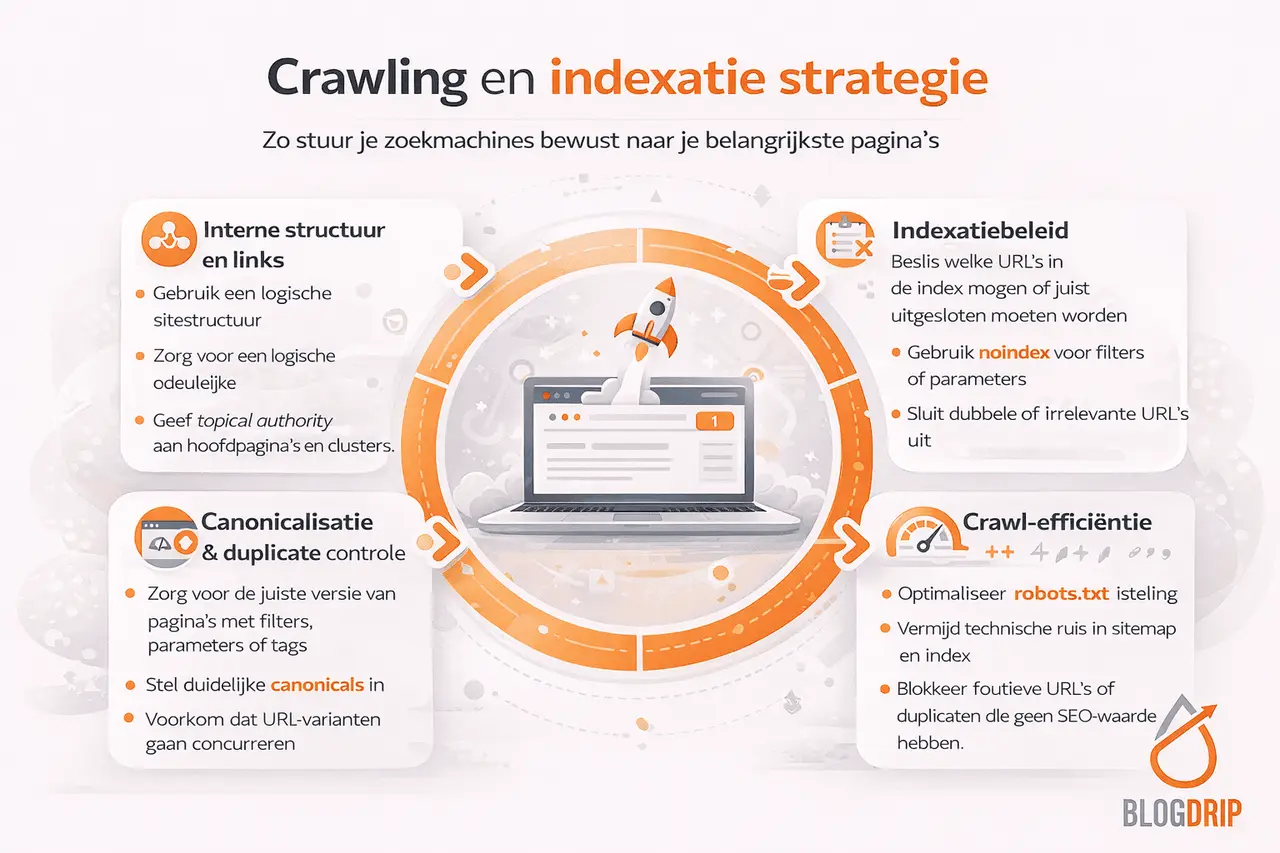

De belangrijkste onderdelen van een crawling en indexatie strategie

Sitestructuur en interne links

Interne links zijn een van de sterkste signalen voor crawling. Ze helpen zoekmachines pagina’s ontdekken en laten zien welke URL’s binnen een onderwerp belangrijk zijn. Binnen een clusterstructuur is dit cruciaal. Hoofdpagina’s moeten duidelijke ondersteuning krijgen vanuit relevante subpagina’s, en andersom.

Een zwakke interne structuur leidt vaak tot vertraagde ontdekking, minder duidelijke prioriteit en versnippering van thematische samenhang.

Indexatiebeleid

Een goede crawling en indexatie strategie bevat altijd een expliciet indexatiebeleid. Welke pagina’s mogen in de index komen? Welke niet? En waarom?

Dit raakt aan noindex, canonical tags, robots-instellingen en URL-selectie. Zonder indexatiebeleid groeit een website vaak ongecontroleerd. Dan ontstaan veel URL’s die technisch bestaan, maar inhoudelijk weinig SEO-waarde hebben.

Canonicalisatie en URL-beheer

Zoekmachines moeten weten welke versie van een pagina de voorkeur heeft. Op websites met filters, parameters of CMS-routes ontstaan anders snel meerdere vergelijkbare URL’s. Een strategie voorkomt dat door canonicals, interne links, redirects en sitemaplogica op elkaar af te stemmen.

Het gaat hier niet alleen om techniek, maar om consistentie. Eén sterk signaal is goed. Vijf signalen die elkaar ondersteunen zijn beter.

XML-sitemaps

Een XML-sitemap is een aanvullend hulpmiddel binnen je strategie. Het helpt zoekmachines belangrijke URL’s ontdekken, maar vervangt geen sterke interne linkstructuur. De sitemap is vooral waardevol wanneer die schoon en selectief is opgebouwd.

Dat betekent in de praktijk: vooral indexeerbare, canonieke URL’s opnemen en geen redirects, noindex-pagina’s of irrelevante varianten.

Crawl-efficiëntie

Voor kleine websites is crawl-efficiëntie meestal minder urgent, maar bij grotere sites is het een strategisch onderwerp. Hoe meer irrelevante URL’s zoekmachines tegenkomen, hoe moeilijker het wordt om focus te houden op je belangrijkste pagina’s.

Daarom hoort ook URL-beperking bij de strategie. Minder ruis betekent meer duidelijkheid.

Veelgemaakte fouten zonder duidelijke strategie

Een veelgemaakte fout is denken dat alle gepubliceerde pagina’s automatisch goed worden verwerkt. In werkelijkheid moeten pagina’s eerst ontdekt, begrepen en geselecteerd worden. Zonder duidelijke ondersteuning gebeurt dat niet altijd efficiënt.

Een tweede fout is alle URL’s als even belangrijk behandelen. Daardoor raken belangrijke landingspagina’s ondergesneeuwd tussen technische varianten, filterpagina’s of andere URL’s zonder echte SEO-functie.

Ook zie je vaak dat websites crawling en indexatie reactief benaderen. Pas wanneer een pagina niet rankt of niet in Google verschijnt, wordt onderzocht wat er mis is. Strategisch werken betekent juist eerder keuzes maken, zodat problemen minder snel ontstaan.

Praktische aanpak: zo bouw je een crawling en indexatie strategie op

Begin met het benoemen van je kernpagina’s. Welke URL’s moeten echt organisch presteren? Denk aan categoriepagina’s, pillar pages, hoofdservices of andere landingspagina’s met strategische waarde.

Controleer daarna of deze pagina’s intern goed bereikbaar zijn. Krijgen ze contextuele links? Staan ze logisch in de navigatie? Zijn ze technisch toegankelijk en indexeerbaar?

Vervolgens kijk je naar URL-typen. Welke soorten pagina’s bestaan er op je website? Welke daarvan hebben SEO-waarde, en welke zijn vooral functioneel? Op dat punt maak je onderscheid tussen wat je wilt laten groeien en wat je juist wilt neutraliseren via noindex, canonicalisatie of andere technische keuzes.

Daarna controleer je of je technische signalen dezelfde richting op wijzen. Interne links, canonicals, redirects, statuscodes en sitemaps moeten elkaar ondersteunen. Zodra die signalen conflicteren, verliest je strategie aan kracht.

Tot slot kijk je naar patronen. Ontstaan er op template-niveau problemen? Genereert je CMS te veel varianten? Raken bepaalde typen pagina’s onbedoeld in de index? Daar zit vaak de grootste structurele winst.

Wanneer zie je resultaat?

Dat hangt af van het soort probleem dat je oplost. Wanneer belangrijke pagina’s onbedoeld buiten de index vielen, kan herstel relatief snel zichtbaar worden. Bij bredere verbeteringen in structuur, canonicalisatie of URL-beheer duurt het vaak langer voordat zoekmachines alle signalen opnieuw verwerken.

Daarom is een crawling en indexatie strategie geen snelle ingreep, maar een manier om de technische voorwaarden voor stabiele groei te verbeteren. De grootste winst zit vaak in meer duidelijkheid, betere focus en minder verspilling van aandacht op irrelevante URL’s.

Conclusie

Een sterke crawling en indexatie strategie zorgt ervoor dat zoekmachines niet willekeurig door je website bewegen, maar duidelijke signalen krijgen over welke pagina’s belangrijk zijn en welke URL’s in de index thuishoren.

Dat maakt deze strategie essentieel voor websites die willen groeien via SEO. Zeker binnen een pillar-and-cluster model helpt het om hoofdonderwerpen, ondersteunende content en technische signalen op elkaar af te stemmen.

De kern is eenvoudig: bepaal wat belangrijk is, ondersteun dat via structuur en techniek, en beperk ruis waar die geen SEO-waarde toevoegt. Precies daar begint een website die niet alleen content publiceert, maar ook technisch klaar is om duurzaam te groeien.