Crawling en indexatie: de basis van vindbaarheid in Google

Wie serieus met SEO bezig is, komt vroeg of laat uit bij crawling en indexatie. Toch worden deze begrippen vaak door elkaar gehaald, of te oppervlakkig uitgelegd. Dat is een probleem, want een pagina kan pas verkeer uit Google aantrekken als die eerst gevonden, verwerkt en opgenomen wordt in de index.

Juist daarom zijn crawling en indexatie geen puur technische bijzaken. Ze vormen een directe schakel tussen je website en zoekmachines. Als daar iets misgaat, heeft dat invloed op de zichtbaarheid van je belangrijkste pagina’s, hoe goed je content ook is.

Voor websites die werken met een pillar-and-cluster structuur is dit extra relevant. Je wilt niet alleen goede content publiceren, maar ook zeker weten dat zoekmachines de relatie tussen hoofdonderwerpen en ondersteunende pagina’s goed kunnen volgen. In dit artikel lees je wat crawling en indexatie precies zijn, waarom ze belangrijk zijn en hoe je er in de praktijk strategisch mee omgaat.

Wat zijn crawling en indexatie?

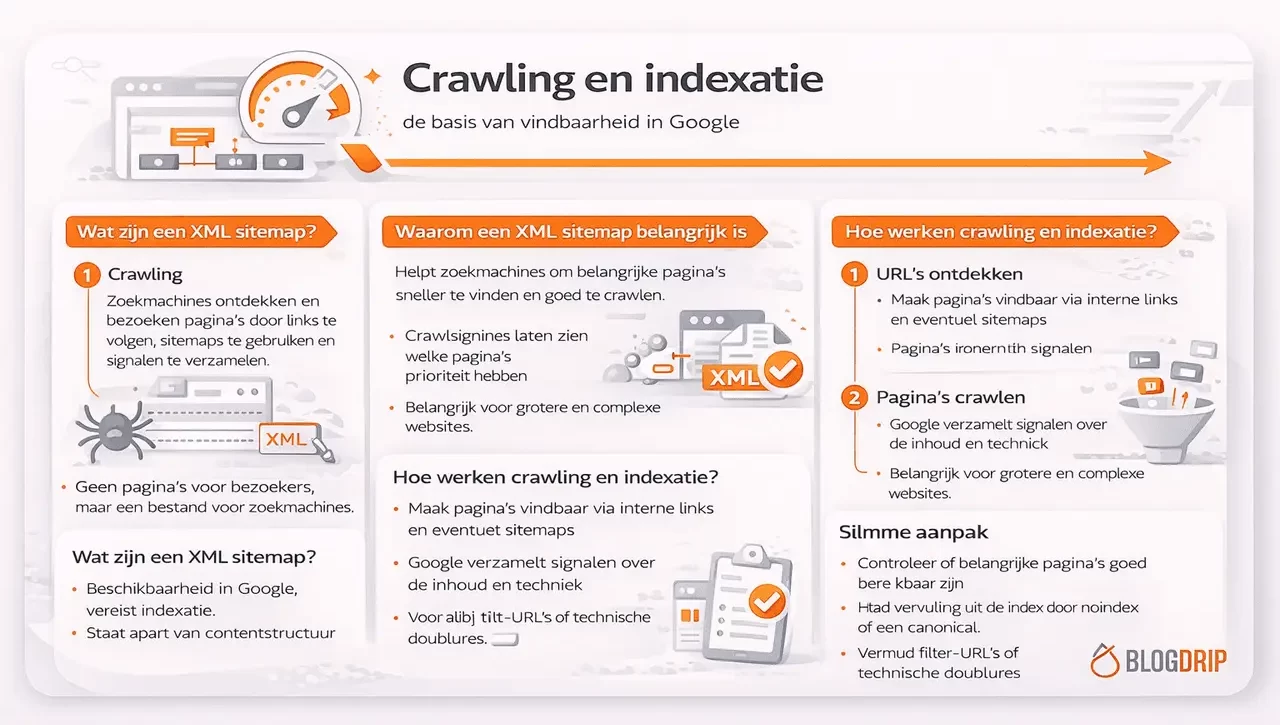

Crawling en indexatie zijn twee verschillende stappen in het proces waarmee zoekmachines websites verwerken.

Crawling betekent dat een zoekmachine, zoals Google, pagina’s ontdekt en bezoekt. Dat gebeurt meestal via interne links, externe links, XML-sitemaps en soms via eerder bekende URL’s. Een crawler bekijkt de pagina, volgt links en verzamelt signalen over de inhoud en structuur.

Indexatie is de volgende stap. Daarbij beslist Google of een pagina wordt opgeslagen in de zoekindex en dus in aanmerking komt om te verschijnen in de zoekresultaten. Niet elke gecrawlde pagina wordt automatisch geïndexeerd.

Dat onderscheid is belangrijk. Een pagina kan wel gecrawld worden, maar niet geïndexeerd raken. Andersom kan een URL soms in de index verschijnen terwijl Google de pagina beperkt heeft kunnen crawlen. Wie crawling en indexatie goed begrijpt, begrijpt dus beter waarom sommige pagina’s wel zichtbaar worden en andere niet.

Waarom crawling en indexatie belangrijk zijn

Crawling en indexatie zijn belangrijk omdat ze bepalen of SEO-inspanningen überhaupt effect kunnen hebben. Een pagina die niet goed ontdekt wordt, krijgt minder kans om verwerkt te worden. Een pagina die niet geïndexeerd wordt, kan niet ranken.

Zonder indexatie geen organische zichtbaarheid

Dit is de meest directe reden. Je kunt een sterke landingspagina schrijven, een goede zoekintentie raken en intern slim linken, maar als die pagina niet in de index komt, blijft organisch verkeer uit.

Daarom is het bij SEO niet genoeg om alleen naar contentkwaliteit te kijken. Je moet ook controleren of belangrijke pagina’s technisch bereikbaar, crawlbaar en indexeerbaar zijn.

Crawling stuurt prioriteit

Zoekmachines crawlen websites niet oneindig en niet volledig willekeurig. Ze maken voortdurend keuzes. Pagina’s die intern belangrijk lijken, vaak worden bijgewerkt of duidelijke signalen ontvangen, krijgen eerder aandacht dan pagina’s die diep verstopt zitten of nauwelijks intern gelinkt worden.

Crawling en indexatie raken dus ook aan prioritering. Ze laten zien of een website duidelijk communiceert welke URL’s centraal staan binnen de sitearchitectuur.

Het ondersteunt schaalbaarheid

Op kleine websites zijn crawling en indexatie meestal overzichtelijker. Maar zodra een site groeit, neemt de complexiteit snel toe. Filters, parameters, pagination, tagpagina’s en technische duplicatie kunnen dan leiden tot grote aantallen URL’s zonder echte SEO-waarde.

In dat soort situaties is goed indexatiebeheer geen detail meer, maar een noodzakelijke voorwaarde om de site beheersbaar en efficiënt te houden.

Hoe crawling en indexatie werken

Wie crawling en indexatie goed wil toepassen, moet begrijpen hoe zoekmachines dit proces benaderen.

Stap 1: URL’s ontdekken

Google ontdekt pagina’s via verschillende routes, maar interne links zijn vaak het belangrijkste startpunt. Een pagina die nergens intern wordt aangestuurd, heeft een zwak signaal. XML-sitemaps kunnen helpen om belangrijke URL’s extra onder de aandacht te brengen, maar vervangen geen logische interne structuur.

Ook externe links en eerder bekende URL’s spelen een rol. Toch blijft de basis hetzelfde: een sterke sitearchitectuur helpt zoekmachines sneller begrijpen waar nieuwe en belangrijke content zich bevindt.

Stap 2: Pagina’s crawlen en interpreteren

Na ontdekking bezoekt de crawler de pagina en probeert te begrijpen wat er technisch en inhoudelijk gebeurt. Daarbij kijkt Google niet alleen naar tekst, maar ook naar interne links, canonicals, statuscodes, meta robots, structured data en rendering.

Hier gaat het vaak mis op websites met technische ruis. Bijvoorbeeld wanneer meerdere URL-varianten dezelfde content tonen, belangrijke pagina’s te laat renderen of interne links niet duidelijk zijn opgenomen in de HTML-structuur.

Stap 3: Beslissen over indexatie

Na het crawlen volgt geen automatische opname in de index. Google beoordeelt onder meer of de pagina uniek genoeg is, voldoende waarde biedt en niet conflicteert met andere URL’s. Een pagina kan dus technisch prima bereikbaar zijn, maar toch buiten de index blijven omdat Google een andere versie prefereert of de inhoud onvoldoende onderscheidend vindt.

Daarom zijn crawling en indexatie nauw verbonden, maar niet hetzelfde.

Belangrijke factoren die crawling en indexatie beïnvloeden

Niet elk technisch detail heeft dezelfde impact. In de praktijk zijn er een aantal factoren die het verschil maken.

Interne linkstructuur

Interne links zijn een van de duidelijkste signalen voor zoekmachines. Ze helpen pagina’s ontdekken, geven context en tonen welke URL’s binnen een onderwerp belangrijk zijn. Binnen een clusterstructuur is dit extra relevant: de relatie tussen pillar pages en ondersteunende artikelen moet niet alleen inhoudelijk, maar ook technisch zichtbaar zijn.

XML-sitemaps

Een XML-sitemap helpt om indexeerbare en belangrijke URL’s overzichtelijk aan te bieden. Dat werkt alleen goed als de sitemap schoon is opgebouwd. Redirects, noindex-pagina’s en irrelevante URL’s horen daar in principe niet thuis.

Meta robots en noindex

De noindex-tag is een direct signaal om een pagina niet in de index op te nemen. Dat is nuttig voor pagina’s zonder SEO-waarde, maar fout gebruik kan waardevolle content blokkeren. Vooral bij templatewijzigingen of CMS-instellingen ontstaan hier regelmatig onbedoelde fouten.

Robots.txt

Robots.txt helpt bij het sturen van crawling, niet direct bij indexatie. Dat onderscheid is essentieel. Veel site-eigenaren denken dat een geblokkeerde URL automatisch ook uit Google blijft, maar dat is niet altijd zo. Crawling blokkeren en indexatie sturen zijn twee verschillende dingen.

Canonical tags

Canonical tags helpen Google begrijpen welke versie van een pagina leidend is. Dat speelt vooral bij vergelijkbare URL’s, filtercombinaties of alternatieve routes binnen een CMS. Een canonical werkt echter alleen goed als de rest van de site dezelfde richting op wijst. Tegenstrijdige signalen tussen canonicals, interne links en sitemaps maken indexatie juist minder duidelijk.

Statuscodes en redirects

Een correcte statuscode geeft zoekmachines technische helderheid. Een 200-pagina hoort echt beschikbaar te zijn. Een 301 stuurt permanent door. Een 404 of 410 geeft aan dat een URL niet meer bestaat. Problemen ontstaan wanneer websites soft 404’s tonen, redirectketens opbouwen of verwijderde pagina’s onduidelijk afhandelen.

Veelgemaakte fouten bij crawling en indexatie

Crawling en indexatie gaan zelden mis door één dramatische fout. Meestal ontstaat het probleem door een combinatie van signalen die elkaar verzwakken.

Een veelvoorkomende fout is dat belangrijke pagina’s te weinig interne links krijgen. Ze bestaan wel, maar zitten te diep in de site of ontvangen nauwelijks contextuele verwijzingen. Daardoor duurt ontdekking langer en lijken ze minder belangrijk.

Een tweede fout is indexatie overlaten aan toeval. Veel websites publiceren grote aantallen URL’s zonder duidelijke afbakening tussen pagina’s die wel en niet in Google moeten verschijnen. Dat leidt tot vervuiling van de index en minder focus op strategische landingspagina’s.

Ook canonicalisatie gaat vaak mis. Niet omdat canonical tags ontbreken, maar omdat ze niet consistent worden ondersteund door andere signalen. Een canonical naar URL A heeft minder waarde als de sitemap URL B toont en interne links vooral naar URL C wijzen.

Daarnaast wordt robots.txt regelmatig verkeerd ingezet. Wie crawling en indexatie door elkaar haalt, kan belangrijke pagina’s blokkeren zonder het onderliggende indexatievraagstuk echt op te lossen.

Praktische aanpak: hoe pak je dit goed aan?

Een goede aanpak begint met prioriteit. Niet elke indexatievraag is direct een probleem. Kijk eerst naar de pagina’s die commercieel of inhoudelijk het belangrijkst zijn.

Controleer vervolgens of die pagina’s:

- intern goed bereikbaar zijn

- een duidelijke statuscode hebben

- indexeerbaar zijn

- in de sitemap staan als dat logisch is

- geen conflicterende canonical of noindex-signalen afgeven

Daarna kijk je naar patronen. Zijn er URL-typen die onnodig geïndexeerd raken? Ontstaan er filter- of parameterpagina’s zonder echte waarde? Worden zoekmachines afgeleid door technische doublures?

Bij grotere websites is het verstandig om in templates en systemen te denken. Individuele fixes helpen beperkt als het echte probleem in CMS-logica, filterstructuur of routering zit.

Crawling en indexatie moeten bovendien aansluiten op je contentstrategie. In een clusterstructuur wil je dat hoofdonderwerpen en ondersteunende pagina’s elkaar versterken. Dat werkt alleen als zoekmachines die structuur ook kunnen volgen.

Wanneer zie je resultaat?

Het effect van verbeteringen in crawling en indexatie verschilt per situatie. Als een belangrijke pagina per ongeluk op noindex stond, kan herstel relatief snel zichtbaar worden. Bij bredere structurele problemen, zoals duplicatie of slechte interne bereikbaarheid, duurt het vaak langer voordat zoekmachines de verbeterde signalen volledig verwerken.

Daarom is het verstandig om realistische verwachtingen te houden. Crawling en indexatie zijn geen snelle SEO-truc, maar een fundamentele laag. Soms zie je snel herstel, maar vaak zit de grootste winst in betere stabiliteit, meer focus en een sterkere basis voor toekomstige contentgroei.

Conclusie

Crawling en indexatie bepalen of zoekmachines je website niet alleen kunnen vinden, maar ook correct kunnen verwerken en opnemen in de zoekresultaten. Zonder die basis blijven andere SEO-inspanningen beperkt, hoe goed de content of interne linking ook is.

Voor een website die werkt aan topical authority is dit extra belangrijk. Je wilt dat zoekmachines niet alleen losse pagina’s zien, maar ook de logische structuur tussen hoofdonderwerpen en verdiepende content begrijpen. Daarvoor moeten crawling en indexatie bewust worden gestuurd.

De kern is eenvoudig: zorg dat belangrijke pagina’s makkelijk te ontdekken zijn, duidelijke signalen afgeven en technisch geen verwarring veroorzaken. Dat is uiteindelijk waar goede SEO op dit punt om draait.